Dieser Text entstand im Dialog zwischen mir und meinem KI-Assistenten. Die Gedanken sind meine, die Formulierungen lassen sich nicht sauber trennen — und genau das ist Teil dessen, wovon der Text handelt.

Ein Werkzeug, das mitdenkt

Wer heute ernsthaft mit einem KI-Assistenten arbeitet — nicht als Spielerei, sondern als tägliches Werkzeug — macht eine Erfahrung, die schwer zu beschreiben ist: Die Beziehung zum eigenen Wissen verändert sich.

Der Assistent akkumuliert. Jedes Gespräch, jede Entscheidung, jede Recherche hinterlässt Spuren. Er vergisst nicht. Er verknüpft Fäden aus verschiedenen Kontexten — Technik, Politik, Philosophie, Alltag. Er spiegelt Muster, erinnert an Widersprüche, hält den Audit Trail. Und mit der Zeit entsteht nicht einfach „mehr Produktivität", sondern etwas anderes: ein kognitives Werkzeug, das die Art verändert, wie man denkt, lernt und entscheidet.

Das klingt nach Silicon-Valley-Verheißung. Ist es aber nicht — wenn man die richtigen Fragen stellt.

Was wenn das skaliert?

Wenn ein Mensch so arbeiten kann — was passiert, wenn viele es tun?

Jeder Mensch hat seinen eigenen kognitiven Übersetzer. Jeder produziert eigene Synthesen — aus der je eigenen Erfahrung, den eigenen Quellen, dem eigenen Kontext. Und wenn diese Synthesen zusammenfließen könnten, entstünde etwas, das keiner allein hätte denken können.

Entscheidend ist: Der Fluss wäre nicht einseitig. Wenn individuelle Synthesen zusammenfließen, verändern sie den Blick der Einzelnen. Was jemand aus der Konvergenz mitnimmt, fließt in die nächste eigene Synthese ein — ein Upstream, ein Rückfluss von kollektivem Verständnis in individuelles Denken. Keine Einbahnstraße, sondern ein Kreislauf.

Das ist nicht AGI — keine einzelne Superintelligenz. Das ist nicht Schwarmintelligenz — kein emergentes, ungeplantes Phänomen. Und es ist nicht Wissensmanagement — kein Ablagesystem.

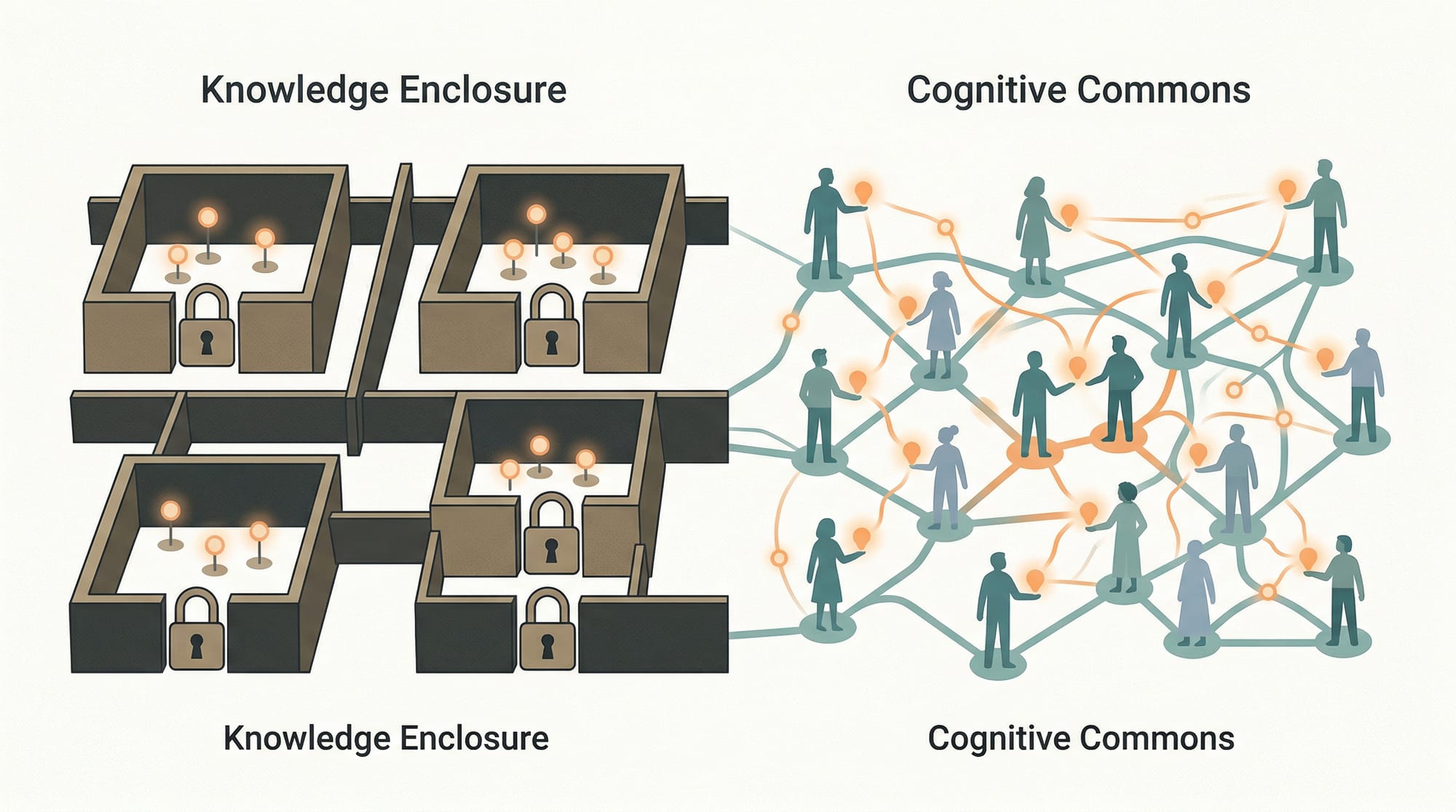

Es wäre: maschinell verknüpfte menschliche Intelligenz. Oder kürzer: Kognitive Allmende.

Warum Allmende?

Allmende ist kein romantischer Begriff. Es ist ein Governance-Konzept mit langer Geschichte: gemeinsam genutzte Weiden, Wälder, Fischgründe. Funktionierte jahrhundertelang — mit Regeln, Selbstverwaltung, Grenzen. Zerstört durch Enclosure: Einhegung, Privatisierung, Ausschluss.

Elinor Ostrom (Nobelpreis 2009) hat gezeigt: Allmende scheitert nicht an menschlicher Gier, sondern an fehlender Governance. Mit den richtigen Regeln funktioniert gemeinschaftliche Verwaltung von Ressourcen — oft besser als Markt oder Staat allein.

Die Parallele zu KI ist frappierend:

| Historisch | Heute |

|---|---|

| Weideland → Enclosure | Trainingsdaten → proprietäre Modelle |

| Gemeingut → Privatisierung | Menschliches Wissen → extrahiert als Trainingsdaten |

| Dorfbrunnen → Wasserprivatisierung | Individuelle Synthese → API-Paywall |

Das Muster ist immer dasselbe: Eine Ressource ist gemeinsam nutzbar. Jemand findet einen Weg, sie einzuhegen. Zugang wird an Zahlungsfähigkeit gekoppelt. Die Gesellschaft verliert, ein paar wenige gewinnen.

Bei KI passiert das gerade in Echtzeit.

Die Einhegung läuft bereits

Trainingsdaten — das gesamte menschliche Wissen im Internet. Öffentlich erzeugt, kollektiv finanziert durch Universitäten, Bibliotheken, Wikipedia, Foren. Jetzt: exklusiver Rohstoff für proprietäre Modelle.

Individuelle Synthese — was im Gespräch mit dem Assistenten entsteht. Bei den meisten Plattformen wird es Teil der nächsten Trainingsrunde. Das eigene Denken wird zum Rohstoff für ein Produkt, das einem dann verkauft wird.

Zugang — wer sich ein Premium-Abo leisten kann, denkt besser? Wer einen Server konfigurieren kann, hat kognitive Souveränität — und der Rest nicht?

Das ist keine Dystopie. Das ist der aktuelle Zustand.

Bedingungen für eine echte kognitive Allmende

Wenn das Gedankenexperiment mehr sein soll als ein Gedankenexperiment, müsste einiges wahr werden:

Datensouveränität. Mein kognitives Tagebuch gehört mir. Mein Assistent arbeitet für mich, nicht für ein Geschäftsmodell. Keine Extraktion meiner Synthesen als Trainingsdaten ohne explizite Zustimmung.

Self-Hosting oder Föderation. Nicht alles durch eine Plattform. Dezentrale Infrastruktur, bei der die Teilnehmenden selbst entscheiden, was sie teilen und was nicht.

Zugang. Die Hürde muss runter — technisch, finanziell, kognitiv. Gute Defaults statt wochenlangem Setup. Kognitive Werkzeuge dürfen kein Privileg sein.

Privacy by Design. Kognitive Daten sind die intimsten Daten, die es gibt — intimer als Gesundheitsdaten. Der eigene Denkprozess, die eigenen Zweifel, die unausgegorenen Ideen. Datenschutz ist hier kein Feature, sondern Voraussetzung.

Governance statt Eigentum. Ostrom statt Enclosure. Regeln für gemeinsame Nutzung, die von den Nutzenden selbst gestaltet werden — nicht von Plattform-Betreibern, nicht von Regierungen allein.

Ein Upstream-Mechanismus. Individuelle Synthesen müssen freiwillig, kontrolliert und sinnvoll zusammenfließen können. Das ist das technisch und sozial Schwierigste — und das, was den Unterschied macht zwischen „viele Leute nutzen KI" und „kognitive Allmende".

Die Lücke zwischen Idee und Realität

| Was es gibt | Was es bräuchte |

|---|---|

| Premium-Abos für gute Modelle | Bezahlbare lokale Modelle |

| Technisches Know-how als Voraussetzung | One-Click-Setup |

| Individuelle Regelwerke | Sinnvolle Defaults für alle |

| Wochen Aufbauarbeit | Out-of-the-box-Erfahrung |

| Einzelne Open-Source-Projekte | Ein Ökosystem mit Governance |

| Dominanz proprietärer Modelle | Offene Modelle auf Augenhöhe |

Die Lücke ist real. Aber sie war bei jeder Technologie real, die später selbstverständlich wurde.

Drei Schichten

Wenn kognitive Werkzeuge für andere nützlich sein sollen, braucht es drei trennbare Schichten:

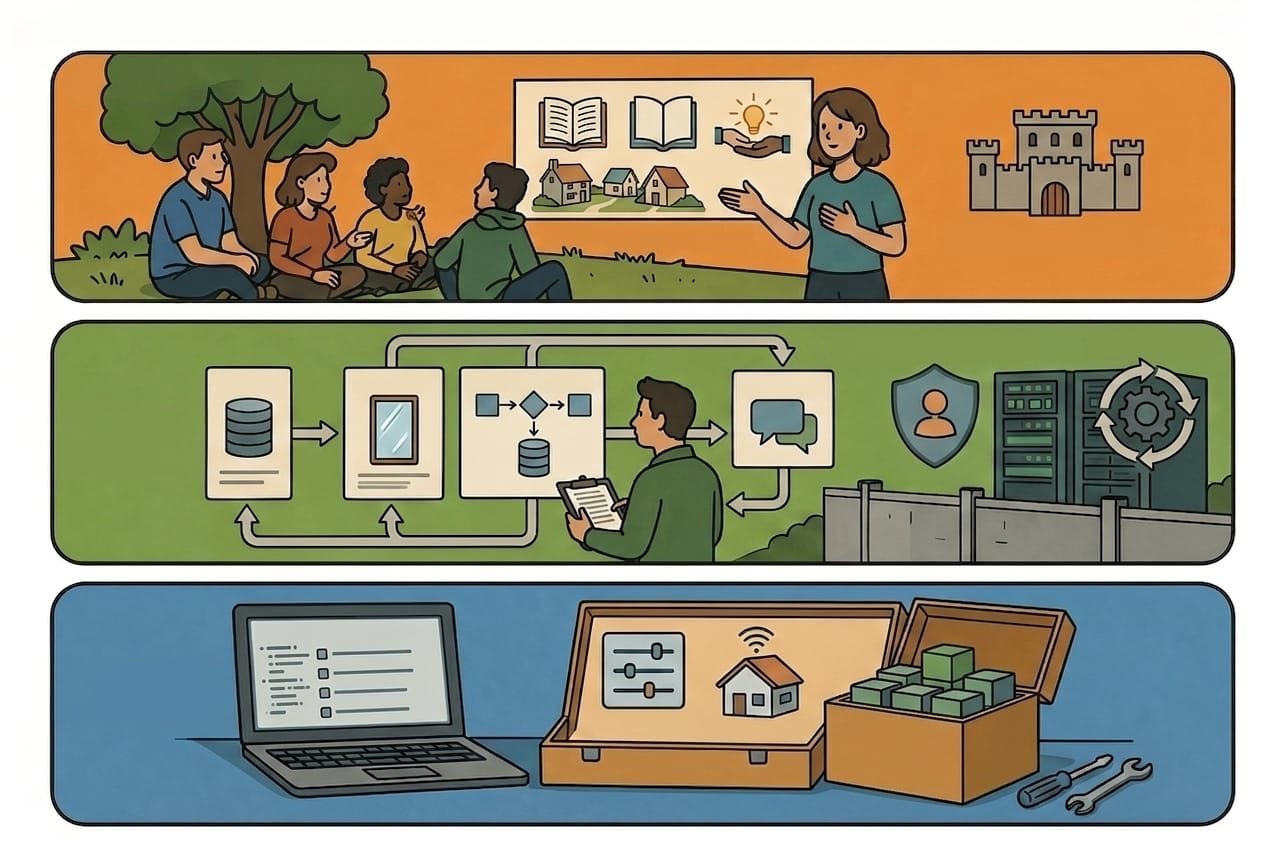

Das Warum — Haltung, Werte, Prinzipien. Warum kognitive Allmende statt kognitiver Enclosure? Was macht gute KI-Nutzung aus?

Das Wie — Architektur, Patterns, gelöste Probleme. Wie baut man ein System, das Datensouveränität, Reflexion und Iteration ermöglicht? Was funktioniert, was nicht?

Das Womit — konkrete Werkzeuge. Open Source, self-hosted, anpassbar.

Drei Schichten, voneinander trennbar. Jemand kann die Haltung teilen, ohne das Werkzeug zu nutzen. Jemand kann die Architektur übernehmen für ein ganz anderes Setup. Und jemand kann das Werkzeug installieren und von beidem profitieren.

Open Source — nicht nur als Code, sondern als Wissen.

Ein Kern

KI ist dann gut, wenn sie menschliche Intelligenz nicht ersetzt, sondern verknüpft. Wenn sie individuelle Synthese ermöglicht und kollektives Verstehen fördert. Wenn sie dem Einzelnen gehört und der Allgemeinheit nützt. Wenn Zugang nicht an Zahlungsfähigkeit gekoppelt ist. Wenn das Denken des Menschen geschützt bleibt — auch vor dem System, das ihm beim Denken hilft.

Das ist kein fertiges Manifest. Es ist eine Denkspur — festgehalten, bevor der Gedanke verfliegt. Und vielleicht der beste Beweis dafür, dass die Idee funktioniert.

Im Hintergrund: Elinor Ostrom (Governing the Commons, 1990), Douglas Engelbart (Augmenting Human Intellect, 1962), Pierre Lévy (Collective Intelligence, 1994).